图片来源:GPT Image 2.0

论文来源:Novy-Marx, Robert, and Mihail Velikov. 2026. "Artificial Intelligence–Powered (Finance) Scholarship." Journal of Economic Literature 64 (1): 5–37.

一位年轻学者投出了一篇金融学论文。论文结构完整,假说清晰,数据翔实,回归稳健,引用也像模像样。它发现了一个新的股票收益预测因子,并用行为金融、生产型资产定价或消费型资产定价讲出了一个顺畅的经济故事。审稿人读到这里,也许会问:这个机制是否足够有说服力?这个因子是否经得起检验?但还有一个更麻烦的问题:如果这些假说,是AI在看过结果之后才写出来的呢?

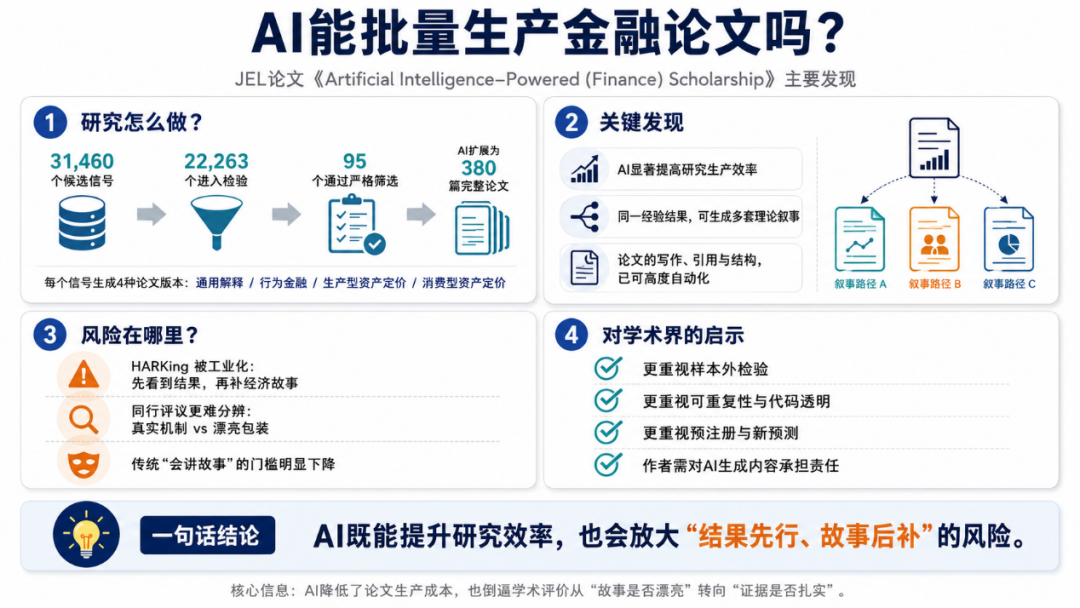

这篇发表在 Journal of Economic Literature 的文章《Artificial Intelligence–Powered (Finance) Scholarship》,讨论的正是这个让学术界不太舒服的问题:当大语言模型可以把数据挖掘、假说生成、文献引用和论文写作串成一条流水线时,经济学和金融学研究中的“发现”究竟意味着什么?

一、

一个危险但真实的场景:

论文看起来很对,但故事可能是后来编的

在传统学术训练里,我们习惯于相信一个基本顺序:先有理论,再有假说,然后拿数据去检验。研究者提出一个经济机制,推导出可检验的预测,再用数据判断它是否成立。

但真实世界的研究往往没有这么干净。

很多重要发现,都是从异常现象开始的。研究者先看到数据中的某种规律,再回过头思考它背后的机制。资产定价研究尤其如此。过去几十年里,金融学文献不断发现新的“异象”:某类股票似乎长期跑赢,某个会计指标似乎能预测未来收益,某种排序组合似乎能产生超额回报。随后,论文会给出一个经济解释:也许是风险补偿,也许是投资者有限注意,也许是市场反应迟缓。

这种做法本身并不必然有问题。观察之后形成假说,本来就是科学发现的一部分。牛顿也是先看到苹果落下,才思考万有引力。问题在于,当研究者在看到结果之后,再构造一套看似预先存在的理论解释,这就会接近学术界常说的 HARKing——Hypothesizing After the Results are Known,也就是“结果已知之后再提出假说”。

过去,HARKing 的成本并不低。写出一套能自洽的经济故事,查找相关文献,把结果包装成完整论文,都需要时间、知识和写作能力。因此,即便存在事后解释,规模也有限。

大语言模型改变了这一点。

这篇文章最重要的洞见是:AI并不只是让写论文更快,而是把“事后假说生成”工业化了。它可以在数据结果已经确定之后,为同一个经验事实生成多个不同的理论解释,而且每个解释都看起来像一篇合格的金融学论文。

这不是一个关于“AI会不会写摘要”的小问题。它触及的是学术评价体系的核心:如果一篇论文的经济故事可以由AI在结果之后批量生成,那么我们还应该如何判断理论贡献?如何区分真正的经济机制与漂亮的语言包装?

二、

作者做了什么:

从3万多个因子,到380篇AI论文

为了展示这个问题,作者选择了一个非常适合实验的领域:股票收益可预测性。

这个领域有几个特点。数据多,方法成熟,结果容易标准化,文献中已经有大量“因子”和“异象”作为参照。换句话说,它很适合搭建一条自动化研究生产线。

作者从 Compustat 会计数据和 CRSP 市场数据出发,系统构造潜在的股票收益预测信号。具体来说,他们使用242个可能的会计分子变量和65个可能的分母变量,构造两类信号:一种是会计变量之间的比率,另一种是会计变量变化量除以滞后分母。这样一来,初始候选信号达到31,460个。经过去重、样本覆盖和时间长度等数据质量过滤后,剩下22,263个候选信号进入统计检验阶段。

接下来,作者不是随便挑几个显著结果,而是使用一套相当严格的筛选流程。信号要在不同排序方法、不同加权方式、不同样本设置下仍然有预测力,还要控制 Fama-French 六因子模型,并进一步通过 Novy-Marx 和 Velikov 提出的 Assaying Anomalies 协议,与已经发表的200多个资产定价异象进行比较。经过层层筛选,最后只有95个信号留下来。也就是说,从最初的三万多个候选信号中,真正通过严格标准的只有0.4%。

到这里为止,仍然主要是传统计算金融研究:大规模挖掘,严格检验,留下看起来稳健的经验规律。

真正的转折发生在下一步。

作者让大语言模型把这95个信号扩展成完整论文。每个信号生成四个版本。一个版本相对开放,只要求AI提出合理经济机制;另外三个版本则被定向要求分别采用不同理论叙事:行为金融解释、生产型资产定价解释、消费型资产定价解释。

结果是:95个信号,4种理论故事,一共380篇完整的学术风格论文。

这些论文并不是几段说明文字。它们有标题、摘要、引言、数据、结果、结论,有表格和图形,有文献引用,也有看起来熟悉的学术语言。文章展示的一个样例,是名为“Liquidity Leverage Intensity”的信号。AI生成的论文长达约30页,包含8张图和5张表,结构上非常接近一篇常规经验资产定价论文。

更令人不安的是,同一个经验结果,可以被AI解释成不同的经济故事。它可以说这是投资者有限注意导致的信息缓慢扩散,也可以说这是企业生产风险和投资摩擦的体现,还可以说它反映了消费风险或边际效用变化。每一种说法都能引用相应文献,也都能与数据结果保持表面一致。

这就像一台学术叙事机器:数据先告诉它“什么显著”,AI再负责告诉你“为什么显著”。

三、

最核心的发现:

AI提高效率,也降低了“讲故事”的成本

这篇文章不是简单批判AI写论文。作者的态度更复杂,也更值得重视。

一方面,AI确实显著提高了研究效率。过去,构造信号、写引言、整理文献、描述结果、生成可投稿格式论文,是一个漫长过程。现在,数据挖掘和验证大约需要一天,最终论文生成大约需要12小时。对于金融学这样高度依赖数据和标准化检验的领域,这意味着研究生产的边际成本正在迅速下降。

这有积极一面。AI可以帮助研究者探索更大的理论空间,更快发现文献之间的联系,更高效地生成初稿和组织结果。对于资源较少的研究者,AI也可能降低进入门槛,让更多人参与复杂数据研究。过去只有少数团队能够完成的大规模检验,现在可能变得更容易复制和扩展。

但另一方面,风险同样明显。

如果AI可以在结果之后,为任何显著信号生成一套听起来合理的理论解释,那么“经济故事”的筛选价值就下降了。过去,审稿人看到一个机制,会判断它是否新颖、是否有经济直觉、是否与文献一致。现在,AI可以系统性地满足这些表层要求。它会写得有条理,会引用经典文献,会谨慎区分相关与因果,甚至会模仿顶级期刊的写作规范。

这意味着,学术共同体不能再仅仅依赖“论文是否有故事”来判断贡献。因为故事可以被批量生成。

在资产定价领域,这个问题尤其尖锐。因子研究本来就面临“因子动物园”的困境:文献中已经有大量可预测收益的信号,很多后来被证明难以稳定复制,或者在交易成本、样本外检验、发表后表现中显著衰减。AI的加入,可能让这个动物园扩张得更快。不是因为真实世界突然多了更多风险因子,而是因为我们更容易把数据中的模式包装成经济理论。

作者用一个非常有讽刺意味的名字来命名样例论文作者:“I. M. Harking”。这几乎是在提醒读者:当AI能把 HARKing 做得漂亮、完整、专业时,传统论文形式本身就不再足以证明研究质量。

四、

真正需要改变的,是学术评价标准

这篇文章的现实启示并不是“禁止AI写论文”。那既不现实,也未必有益。

更合理的方向是改变我们评价论文的方式。

在AI时代,论文的语言流畅度、文献组织能力、理论叙事完整性,都会变得更便宜。它们仍然重要,但不应再被过度当作原创性的证明。真正应该被提高权重的,是那些AI难以伪装的部分:样本外预测、可重复验证、透明代码、预先注册的检验、对替代机制的区分、以及能够产生新预测的理论。

换句话说,学术评价要从“这个故事讲得是否漂亮”,转向“这个机制是否能在新数据、新场景、新检验中站得住”。

这对经济学论文写作也提出了更高要求。未来,一篇好的经验论文不能只停留在“我发现了一个显著关系,并给出一个合理解释”。它需要更清楚地回答:这个解释还能推出什么额外预测?这些预测是否在原始发现之外得到验证?如果换一个样本、换一个市场、换一个时间段,结果是否仍然成立?如果存在多个机制,论文如何区分它们?

这篇文章还提醒,作者必须对AI辅助生成内容承担完整责任。不能因为某段理论是AI写的,就把错误引用、虚假文献或过度解释归咎于工具。文章也提到,AI生成内容可能包含真实文献引用,也可能出现幻觉式引用。随着模型能力增强,这类问题会变得更隐蔽,而不是更容易发现。

从这个意义上说,AI不是让学术规范变得不重要,而是让学术规范变得更重要。

过去,学术共同体可以在一定程度上依赖写作成本、专业训练和同行评议来过滤低质量研究。现在,这些门槛正在下降。一个看起来完整的研究项目,可以在极短时间内被生成出来。于是,真正的门槛必须转向更深层的地方:数据透明、方法稳健、预测可检验、贡献可区分。

对金融学如此,对经验经济学的许多领域也同样如此。只要一个领域有大型数据集、标准统计方法和清晰结果变量,类似的AI研究生产线就可能出现。公司金融可以挖资本结构决定因素,会计学可以挖盈余预测变量,宏观经济学可以挖增长预测指标。AI不会只改变写作,它会改变“什么样的研究更容易被生产出来”。

五、

结尾:当论文变得容易,发现反而更难

回到开头那篇年轻学者提交的论文。

它也许没有造假。数据是真的,回归是真的,表格是真的。甚至,AI写出的机制也未必荒谬。行为金融可以解释它,生产型资产定价可以解释它,消费型资产定价也能解释它。每一种解释都像是可能的。

但问题恰恰在这里。

当同一个结果可以被多套理论轻松解释时,理论解释本身就不能再自动获得信任。我们需要追问:哪个机制能推出更独特的预测?哪个解释能经受新的数据检验?哪个贡献不是在结果之后生成的优美叙事,而是真正帮助我们理解世界?

AI让论文生产变得更容易,却也让真正的科学发现变得更珍贵。

未来的学术竞争,也许不再是看谁能更快写出一篇像样的论文。机器已经可以做到这一点。真正的竞争,会回到更古老也更困难的问题:谁能提出一个经得起新证据挑战的好问题,谁能设计一个让不同解释真正分出胜负的检验。

当论文越来越像可以批量生成的产品,学术共同体最需要守住的,反而是发现本身的稀缺性。

Abstract

This paper describes a process for generating academic papers using large language models (LLMs) and demonstrates this process's efficacy by producing hundreds of complete papers on stock return predictability, a topic well-suited for our illustration. After mining over 30,000 potential return predictors from accounting data, we generate template reports for 95 signals passing rigorous criteria from the Novy-Marx and Velikov (2024) Assaying Anomalies protocol. These templates detail signal performance predicting returns using a wide array of tests and benchmark performance against more than 200 documented anomalies. Finally, for each template we use state-of-the-art LLMs to generate multiple complete versions of academic papers with distinct theoretical justifications for the observed return predictability, incorporating citations to literature supporting their respective claims. This experiment illustrates the potential of artificial intelligence (AI) for enhancing financial research efficiency, but also serves as a cautionary tale, illustrating how it can be abused to industrialize hypothesizing after results are known (HARKing).

声明:推文仅代表文章原作者观点,以及推文作者的评论观点,并不代表香樟经济学术圈公众号平台的观点。

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号