阅读:0

听报道

——谣言和科学信息的赛跑

推文人 | 郑筱婷

原文信息

Vicario, M. D., Bessi, A., Zollo, F., Petroni, F., Scala, A., Caldarelli, G., ... & Quattrociocchi, W. (2016). The spreading of misinformation online. Proceedings of the National Academy of Sciences of the United States of America, 113(3), 554-559.

16th December, 2017, Dali, Yunnan Province P.R. China.

谣言和科学信息的传播比赛谁能获胜?看看社会媒体和朋友圈充斥着各种耸人听闻的虚假新闻,答案不言而喻。Michela Del Vicarioa 等人2016年发表在美国科学院院刊上的论文《The spreading of misinformation online》比较了科学的信息(信息后面亦称为新闻)和虚假的信息(阴谋论)的传播规律和特征,结果显示阴谋论被转发的数量遥遥领先,且生存时间不低于科学信息。

世界经济论坛把社交媒体上充斥大量虚假信息作为社会的主要威胁之一。辟谣者揭发信息提供者是在造谣,造谣者反击辟谣者不是在辟谣而是在造谣。那些信息是谣言?究竟谁是造谣者?键盘侠们的口水战往往谁都不能说服谁,为什么?研究显示人们选择性地阅读和转发某些内容(content-selective exposure)是内容扩散的主要驱动力,并且因此形成了同质集群和信息传播的回声室(echo chambers)。围绕阴谋论和科学话题形成了两个高度分割且内部联系紧密的社群。

该研究主要发现了科学信息和阴谋论显示了相同的消费特征,但两者的信息流动的特征(cascade pattern)却迥异。个体之间的同质性是内容扩散的主要动力,但是每一个回声室都有自己的信息流动动态(cascade dynamics)。

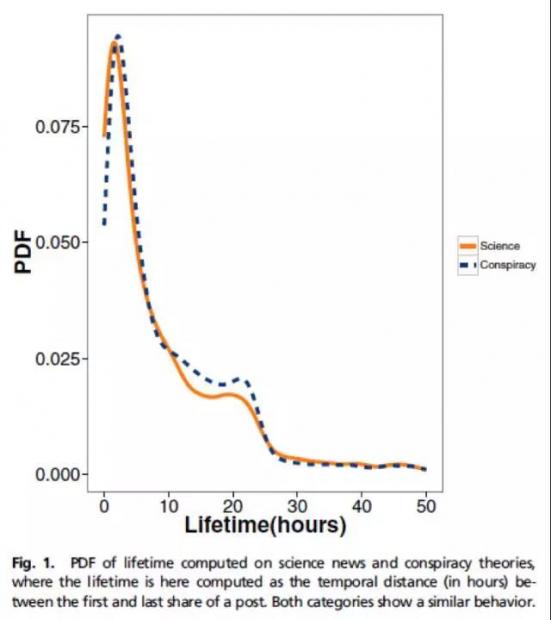

图1是一个新闻的生存时间的概率密度分布,横轴为新闻的时间距离,即第一次转发和最后一次转发之间的时间间隔。易知,两类新闻的生存时间的概率密度分布是非常相似的。不论是阴谋论还是科学新闻大多数生存的时间少于一天,新闻发出后1-2个小时后转发的概率最大。

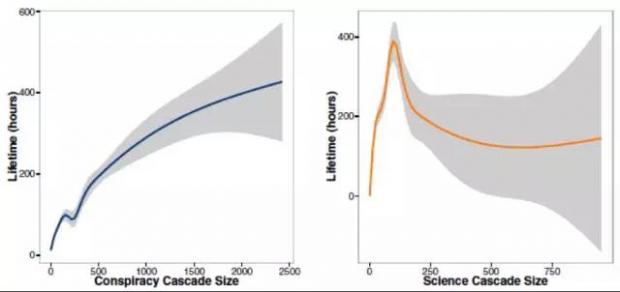

在图2中,纵轴是新闻的生存时间,横轴是转发的数量(cascade size),阴谋论的转发数量随着其生存时间变长而增加。科学信息的生存时间较长,但是生存时间的增加并不能增加其转发的数量。同样生存了400小时的信息,阴谋论的转发数量是科学信息的十数倍。

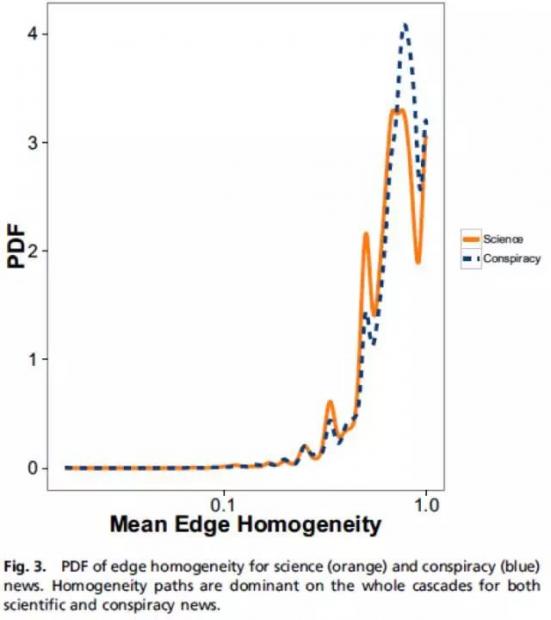

作者定义了用户极化(polarization)为σ=2Q-1,0≤Q≤1是用户对阴谋论相关的内容标记喜欢的比重,因此-1≤σ≤1。根据用户的极化信息,定义边同质度(edge homogeneity),对于任意两个节点i和j的边eij,其边同质度为σij=σi+σj,-1≤σij≤1。边同质度度量了两个分享节点之间的相似度。边同质度为正,那么分享树上的链接是同质的。一个同质的路径是一条分享的路径上每一个链接的边同质度都是正的。

从图3可以看出整个分享瀑布(cascade)的边同质度的平均值都大于等于0,这意味着信息主要是在同质的群体内部转发,或者在混合的人群中转发,但是同质人群中的转发要多于非同质人群的转发。接近于0的平均边同质度的概率接近于0。边同质度越高,其概率就越高,说明信息倾向于在回音室内部传播。正如该文所指出的,信息流模拟实验显示一旦人们接受错误的信念,很少能够得到纠正。一个信息(不论其是否为谣言)能否被人接受,既受社会规范的影响,也受这个信息是否与个体的信念一致有关,即个人受真实性偏误(confirmation bias)的影响,人们喜欢阅读和聆听能证实自己信念的信息,而不是相反。

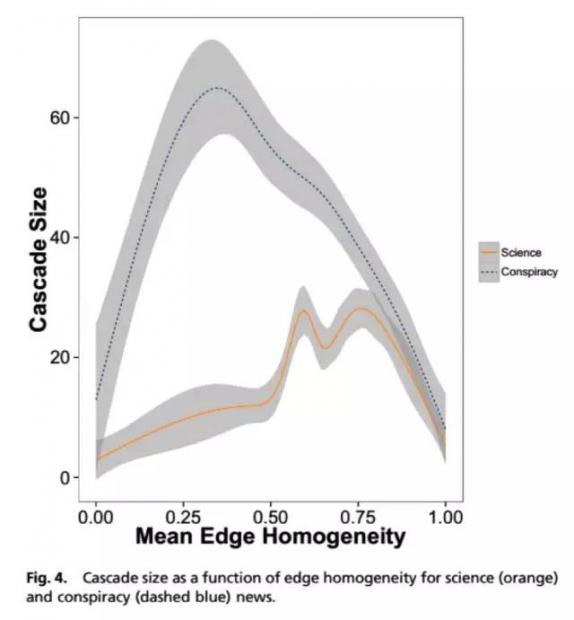

图4则展示了边同质度与信息流规模之间的关系。科学的信息,同质度在(0.5,0.8)之间的话,同质性越高传播的数量会越大。但是,阴谋论在(0,0.25)之间有同质度越高,转发数量越多。同质度是信息扩散的主要推动力。科学信息的传播依赖于更高的同质度,对于用户的要求更高,谣言的传播却不需要那么高的同质度,这也能解释谣言传播的数量要远胜于科学信息。

自媒体的自由表达,很多没有任何考证核实。如果虚假的信息传播的速度比科学考证的信息快、数量多,那么我们的周围会充斥着各种虚假信息。在虚假信息与无用信息的森林里如何能找到那片真相的树叶?对此,笔者感到森森的无力感。

科学的素养和的品味是需要积累的和慢慢培养的,不是普罗大众都拥有的。为了应对虚假信息,谷歌正在研发信任指数来对搜索的结果排序。同样,Facebook建议采用一种社区驱动的方法来标记错误的内容以纠正新闻推送的算法。这个做法是有争议的,因为人们担心这将威胁到个人自由发布内容,同时,建议的算法也未必准确有效。社交媒体改变了世界,也许未来是光明的。

结语

社交媒体使我们获得信息的手段越来越的多,越来越便捷,但是由于存在自己主动筛选和被动被推送的问题,我们看到的“事实”往往是有偏的,我们寻找能够证实自己信念的信息,对有悖于自己信念的信息熟视无睹,自我证实偏差在生活中无时无刻不在发生作用。我们被我们希望看到和喜欢看到的信息所包围,信阴谋论者和信科学信息者就像是在两个世界中的人,然而各自所看到的并不是世界的全部。这个世界没有因为互联网和社交媒体而变得更加多元,反而促进了极化和谣言的传播。

原文摘要

The wide availability of user-provided content in online social media facilitates the aggregation of people around common interests, worldviews, and narratives. However, the World Wide Web (WWW) also allows for the rapid dissemination of unsubstantiated rumors and conspiracy theories that often elicit rapid, large, but naive social responses such as the recent case of Jade Helm 15––where a simple military exercise turned out to be perceived as the beginning of a new civil war in the United States. In this work, we address the determinants governing misinformation spreading through a thorough quantitative analysis. In particular, we focus on how Facebook users consume information related to two distinct narratives: scientific and conspiracy news. We find that, although consumers of scientific and conspiracy stories present similar consumption patterns with respect to content, cascade dynamics differ. Selective exposure to content is the primary driver of content diffusion and generates the formation of homogeneous clusters, i.e., “echo chambers.” Indeed, homogeneity appears to be the primary driver for the diffusion of contents and each echo chamber has its own cascade dynamics. Finally, we introduce a data-driven percolation model mimicking rumor spreading and we show that homogeneity and polarization are the main determinants for predicting cascades’ size.

话题:

0

推荐

财新博客版权声明:财新博客所发布文章及图片之版权属博主本人及/或相关权利人所有,未经博主及/或相关权利人单独授权,任何网站、平面媒体不得予以转载。财新网对相关媒体的网站信息内容转载授权并不包括财新博客的文章及图片。博客文章均为作者个人观点,不代表财新网的立场和观点。

京公网安备 11010502034662号

京公网安备 11010502034662号